A medida que los datos se multiplican a una velocidad sin precedentes, las organizaciones necesitan herramientas capaces de transformarlos en conocimiento útil. Si bien la inteligencia artificial puede ser de gran ayuda, lo cierto es que no todas las soluciones responden de la misma manera. En este punto es donde entra la Retrieval-Augmented Generation (RAG), o Generación Aumentada por Recuperación, que da lugar a nuevas formas de gestionar la información.

Índice de temas

¿Qué es RAG (Retrieval-Augmented Generation) y cómo funciona?

De acuerdo con el Instituto Nacional de Normas y Tecnología (NIST), RAG es un tipo de sistema de inteligencia artificial generativa en el que un modelo se combina con un sistema de recuperación de información independiente. A partir de una consulta de un usuario, identifica información relevante dentro de una base de conocimiento y la proporciona al modelo de IA generativa. Así, este último la utiliza en la formulación de su respuesta.

Con respecto a la arquitectura de RAG, un artículo publicado en la Revista Internacional de Tendencias Informáticas y Organizacionales identifica cinco componentes principales:

- Canal de procesamiento de documentos: es el responsable de la ingesta, el procesamiento y la indexación de documentos organizacionales de diversas fuentes. Entre ellas se encuentran archivos PDF, documentos de Word, sitios de SharePoint y bases de datos internas.

- Base de datos vectorial: almacena incrustaciones de fragmentos de documentos para una búsqueda y recuperación semántica eficiente. Tiene un control de acceso específico para la empresa y optimizaciones de gestión de versiones.

- Motor de recuperación: identifica y extrae información relevante de la base de datos vectorial según las consultas de los usuarios. Para ello, implementa mecanismos de recuperación híbridos y adaptados a las características de conocimiento de la empresa.

- Componente de generación: genera respuestas relevantes en términos contextuales a partir de la información recuperada. Lo hace con ingeniería de avisos específica para la empresa para garantizar la seguridad, el cumplimiento normativo y la coherencia de la marca.

- Capa de integración: conecta la aplicación de chat con los sistemas y canales de comunicación empresariales existentes. Para hacerlo, proporciona flujos de autenticación y autorización fluidos.

Según Salesforce, el funcionamiento de RAG consiste en un proceso de tres etapas. Primero, en la fase de preprocesamiento e indexación, el sistema toma el conjunto de datos valiosos no estructurados de una empresa y los conecta. Más tarde, en la fase de recuperación, utiliza herramientas de búsqueda semántica para examinar los datos y encontrar lo necesario para responder a una consulta específica.

Por último, en la fase de generación y aumento, un modelo de lenguaje grande (LLM) toma los fragmentos de información recuperados y los emplea para ofrecer la respuesta más relevante posible.

Por ejemplo, se puede imaginar una compañía de telecomunicaciones que acumula grandes volúmenes de información en diversos formatos. Entre ellos se encuentran correos electrónicos de soporte al cliente, manuales técnicos en PDF, transcripciones de chats con usuarios y reportes internos.

El primer paso de RAG es organizar los datos. Tras esto, recibe la consulta de un cliente que se pregunta cómo configurar su router para mejorar la velocidad de internet. En este momento, el motor de RAG busca en la base indexada y encuentra fragmentos relevantes en manuales de instalación. De esta forma, el modelo de lenguaje los utiliza para generar una respuesta adaptada al usuario, en lugar de limitarse a repetir un párrafo del manual.

Beneficios de usar RAG frente a modelos de generación de texto tradicionales

El principal valor de RAG es que rompe con las limitaciones de los sistemas de generación de texto tradicionales. En este sentido, el Instituto de Inteligencia Artificial de Estados Unidos (USAII) destaca los siguientes beneficios en comparación con los modelos de lenguaje clásicos:

- Precisión mejorada: los modelos RAG pueden proporcionar texto más preciso e informativo al aprovechar el conocimiento de una amplia base de datos.

- Mayor comprensión contextual: los modelos RAG pueden comprender mejor el contexto más amplio y los matices del lenguaje al incorporar la recuperación de conocimientos.

- Oportunidad y relevancia: los modelos RAG permiten a los LLM generar respuestas más oportunas al brindar acceso a los datos internos más actualizados de la empresa.

- Mayor confianza: los modelos RAG reducen la probabilidad de que esto ocurra al basar la generación en datos verificados y actualizados de la empresa.

- Más control: los modelos RAG y sus LLM pueden obtener más control al aumentar los datos generales con información de las fuentes que especifique.

- Búsqueda mejorada: los modelos RAG mejoran las funciones de búsqueda al aplicar las ventajas de la IA a los datos de la empresa.

- Sobreajuste reducido: los modelos RAG pueden reducir el sobreajuste al aprovechar el conocimiento de una amplia base de datos, en lugar de solo confiar en patrones estadísticos.

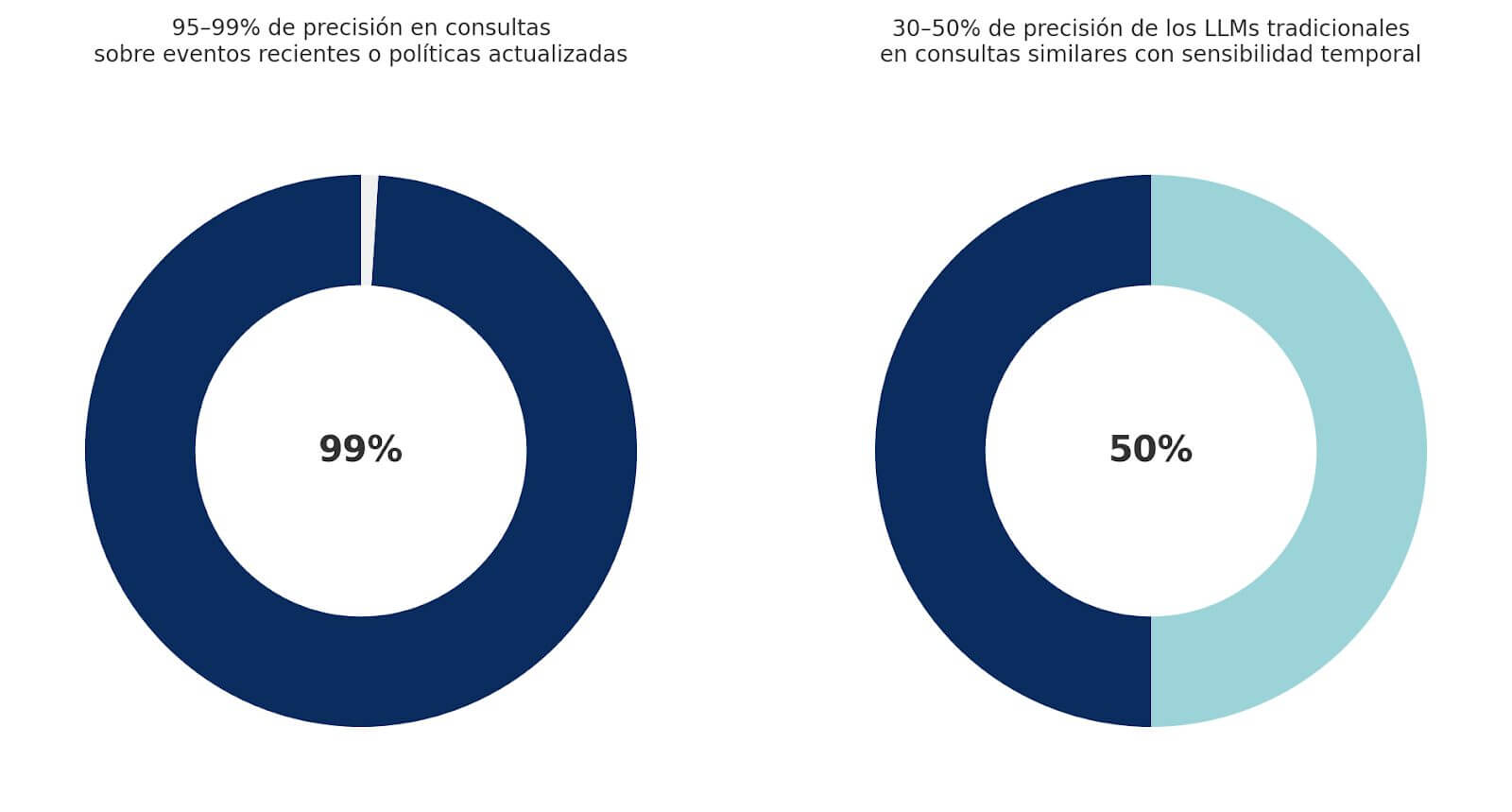

Por otro lado, RAG permite que las respuestas reflejen cambios en la documentación, las políticas o los datos sin tener que volver a entrenar a los modelos. Según datos de Makebot.AI, estos tienen entre 95 y 99% de precisión en consultas sobre eventos recientes o políticas actualizadas. Mientras tanto, los LLM tradicionales tienen entre 30 y 50%.

Aplicaciones empresariales ideales para implementar RAG

En la actualidad, muchas empresas adoptan RAG para que sus sistemas de IA sean más factuales, contextuales y útiles. Su potencial se hace notar en entornos donde la información está dispersa, es compleja y requiere un acceso rápido y confiable. Tal como indica OpenSearch, existen diversos casos de uso con los que se puede aprovechar en todas las industrias:

| Caso de uso | Aplicación |

| Atención al cliente y chatbots | Chatbots de soporte que buscan en bases de conocimiento internas, preguntas frecuentes o documentos de políticas para dar respuestas precisas en tiempo real. Se reducen los tiempos de respuesta, la carga del soporte humano y aumenta la satisfacción del cliente. |

| Recuperación de conocimiento para empleados | Asistentes internos inteligentes que consultan plataformas internas, manuales técnicos y proyectos previos. Facilitan el acceso rápido a políticas, documentos o diseños, evitan silos de información y mejoran la productividad. |

| Preguntas y respuestas específicas del dominio | Aplicaciones en sectores especializados que recuperan datos en tiempo real de bases de datos, investigaciones o jurisprudencia. Garantizan precisión y reducen las probabilidades de alucinaciones al generar reportes o recomendaciones. |

| Personalización y recomendaciones | Motores de recomendación que utilizan datos contextuales como actividad reciente, inventario o tendencias. Personalizan sugerencias de productos, contenidos o campañas de marketing. |

Consideraciones técnicas y perfiles profesionales para desplegar RAG con éxito

Antes de comenzar a utilizar RAG, es importante tener en cuenta una serie de consideraciones técnicas y qué perfiles profesionales se necesitan para abordarlas.

El primer aspecto tiene que ver con la calidad de los datos. Para que el modelo genere respuestas útiles, la información recuperada tiene que ser precisa, actualizada y estar indexada de forma correcta.

También es importante la selección de embeddings y motores de búsqueda. Estos determinan la relevancia y velocidad con la que se accede a los documentos. Asimismo, resulta imprescindible definir políticas de seguridad y gobernanza. Esto, con el objetivo de asegurar que la información sensible se mantenga protegida y que el sistema cumpla con normativas de privacidad.

Los perfiles profesionales indispensables para llevar a cabo estas tareas son:

- Los científicos de datos son quienes diseñan y entrenan los modelos de recuperación de información, definen los criterios de evaluación y aseguran que la información sea representativa y libre de sesgos.

- Los ingenieros de machine learning se ocupan de construir y mantener los pipelines de entrenamiento e inferencia, optimizar el rendimiento del sistema y garantizar que la solución escale de manera eficiente a medida que crecen los volúmenes de datos.

- Los arquitectos de IA se encargan de elegir tecnologías de almacenamiento y búsqueda, diseñar la arquitectura distribuida en la nube o en entornos locales y supervisar la integración con los sistemas existentes de la organización.

Cómo optimizar la integración de RAG en sistemas existentes para mejorar resultados

La implementación de RAG no solo se trata de añadir un módulo de recuperación a un modelo de lenguaje. Para que el sistema aporte valor real, es necesario pensar en la integración de forma estratégica y técnica.

Un primer aspecto clave es la configuración del pipeline de recuperación y generación. Incluye definir cómo se indexa la información, con qué frecuencia se actualiza y cómo se gestiona la conexión entre el motor de búsqueda y el modelo generativo.

Un pipeline bien configurado tiene que balancear velocidad de respuesta con precisión y evitar la sobrecarga de consultas innecesarias y la entrega de información obsoleta.

Por otro lado, es importante detenerse en la elección de bases de datos y motores de recuperación. Los motores vectoriales como Pinecone, Weaviate o Milvus permiten búsquedas semánticas a gran escala.

Por su parte, combinaciones híbridas con ElasticSearch, por ejemplo, son útiles cuando se necesita integrar búsquedas semánticas y keyword search. La decisión final depende del volumen de datos, la latencia aceptable y las necesidades de seguridad.

Otro factor determinante es el fine-tuning o ajuste fino. De acuerdo con la Universidad Brigham Young, consiste en entrenar un modelo lingüístico extenso para que se convierta en experto en la realización de una tarea específica. Con la arquitectura RAG, se pueden suministrar documentos a un servicio de IA generativa para entrenar aún más un modelo. Así, puede ofrecer una respuesta específica para cada necesidad.

A su vez, la monitorización y el uso de métricas de eficacia contribuyen a sostener la calidad en el tiempo. Medir la precisión de recuperación, la utilidad de las respuestas y la latencia promedio permite detectar sesgos, vacíos de información o caídas de rendimiento. Además, la retroalimentación de los usuarios cumple un rol esencial en la evolución del sistema.

Por último, un estudio publicado en Antología ACL destaca dos recetas o prácticas distintas para implementar sistemas RAG, cada una adaptada a requisitos específicos:

- Para lograr el máximo rendimiento, se recomienda incorporar un módulo de clasificación de consultas, utilizar el método “Híbrido con HyDE” para la recuperación, emplear monoT5 para la reclasificación, optar por Reverse para el reempaquetado y aprovechar Recomp para el resumen.

- Para lograr un equilibrio entre rendimiento y eficiencia, se recomienda incorporar el módulo de clasificación de consultas, implementar el método híbrido para la recuperación, usar TILDEv2 para la reclasificación, optar por la recombinación inversa y emplear Recomp para el resumen.

Riesgos y desafíos en proyectos con RAG y cómo mitigarlos

Aunque la adopción de RAG ofrece un gran potencial para mejorar la búsqueda empresarial con IA, su implementación no está exenta de desafíos. Según GeeksforGeeks, algunos de ellos son:

- Complejidad del sistema: la integración de mecanismos de recuperación y generación introduce un nivel adicional de complejidad técnica, ya que ambos componentes deben coordinarse de forma precisa para ofrecer resultados consistentes. Para mitigar este riesgo, se puede establecer un proceso de pruebas iterativas y ajustes continuos, con métricas claras sobre la interacción entre recuperación y generación.

- Latencia en las respuestas: el paso de recuperación previo a la generación puede incrementar el tiempo de respuesta, lo que dificulta el uso de RAG en entornos donde se requiere inmediatez. Para mitigar este riesgo, se debe optimizar la indexación y el motor de búsqueda, además de implementar cachés inteligentes que reduzcan la necesidad de consultas repetitivas.

- Calidad de la recuperación: el desempeño global de RAG depende en gran medida de la relevancia de los documentos recuperados, por lo que, si la información obtenida es de baja calidad, la generación también será deficiente. Para mitigar este riesgo, es clave invertir en un buen pipeline de datos, curar las fuentes de información y entrenar los índices de recuperación con criterios de calidad definidos.

- Sesgo y equidad en los resultados: al igual que otros sistemas de IA, RAG puede heredar sesgos de los datos de entrenamiento o de los documentos recuperados, lo que puede afectar la imparcialidad de las respuestas. Para mitigar este riesgo, se pueden realizar auditorías periódicas de sesgo, diversificar las fuentes de información y aplicar filtros o técnicas de debiasing que promuevan resultados más equitativos.

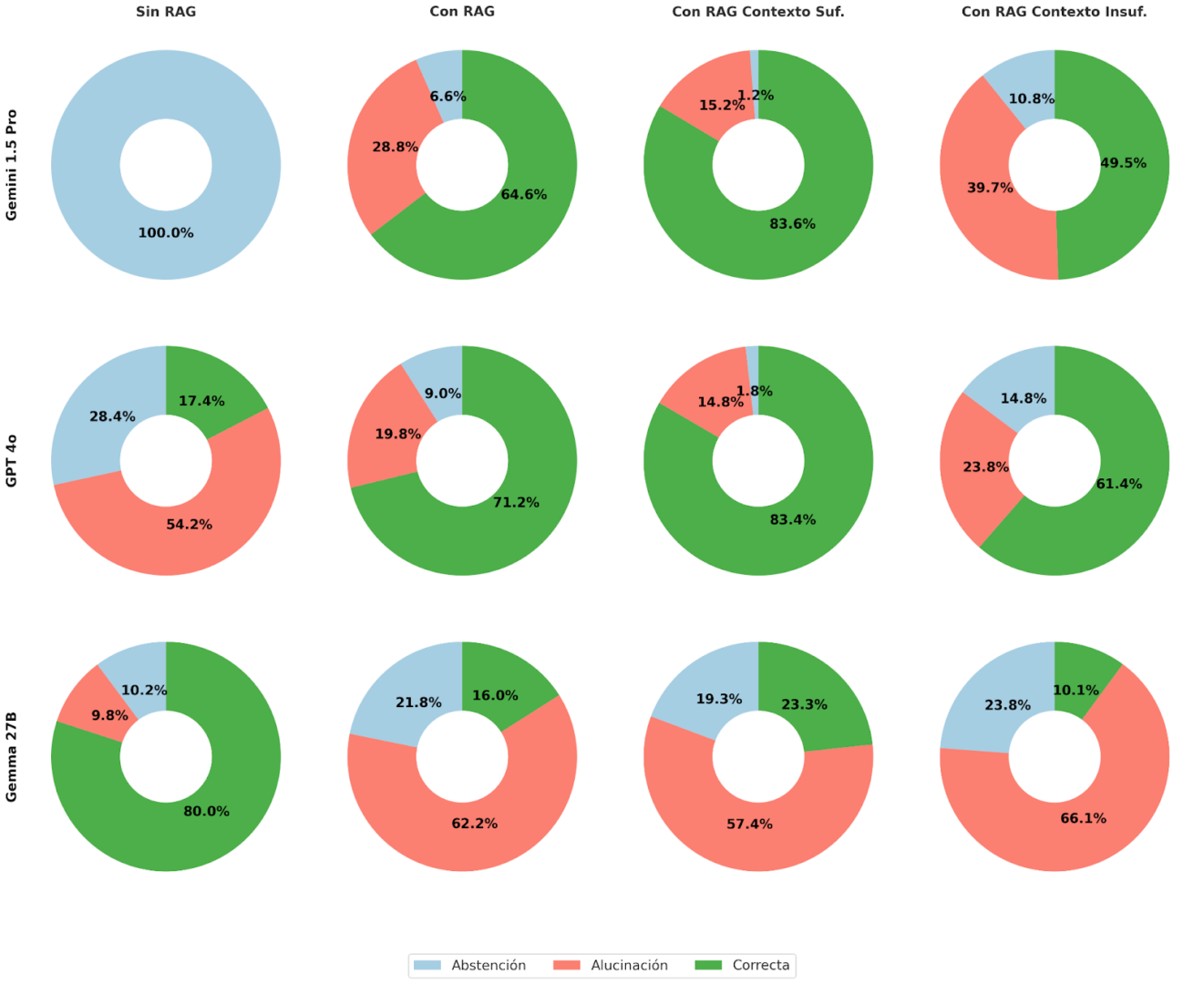

Por último, cabe destacar que, si bien el uso de RAG suele mejorar el rendimiento general, al mismo tiempo reduce la capacidad de los modelos para abstenerse de responder cuando corresponde.

En este sentido, una investigación de la Universidad de Cornell demostró que proporcionar contexto adicional aumenta la confianza de los modelos, lo que resulta en una mayor propensión a la alucinación en lugar de la abstención.

Para llevar a cabo el análisis, se tomaron en cuenta los modelos Gemini 1.5 Pro, GPT 4o y Gemma 27B y se clasificaron cada una de sus respuestas como “Correcta”, “Alucinación” o “Abstención”. Los primeros dos tuvieron más de un 80% de respuestas correctas con RAG y contexto suficiente. Mientras tanto, el tercero registró más del 50% de respuestas alucinadas en las mismas condiciones.

Escalabilidad y mantenimiento de soluciones basadas en RAG para entornos empresariales

Uno de los mayores desafíos al implementar RAG en empresas es garantizar que las soluciones puedan escalar y al mismo tiempo mantener un rendimiento consistente. Por ejemplo, con el fin de gestionar el crecimiento de los datos, es fundamental establecer procesos de indexación incremental y pipelines que mantengan la base de conocimiento actualizada sin necesidad de reprocesar todo desde cero.

Además, en busca de optimizar el rendimiento, se recomiendan estrategias de caching inteligente, precomputación de embeddings más consultados y balanceo de carga entre múltiples servidores. La monitorización continua de métricas como latencia, tasa de aciertos y costos de infraestructura ayuda a anticipar cuellos de botella y a optimizar recursos.

En cuanto a la actualización de los modelos, dado que no pueden permanecer estáticos en un entorno empresarial dinámico, es necesario implementar ciclos de reentrenamiento o ajuste fino que incorporen nuevos contextos, vocabulario específico del negocio y cambios en la terminología de la industria. Para ello, es aconsejable combinar versionado de modelos con pruebas A/B para evaluar mejoras antes de su despliegue general.

Por último, más allá de la tecnología, la sostenibilidad de RAG depende de una estrategia de gobernanza de datos y un equipo responsable de supervisarla. Esto incluye controlar la calidad de las fuentes, definir políticas claras de seguridad y acceso, y aplicar herramientas de auditoría. En este punto, la automatización juega un papel central. En este punto, la automatización juega un papel central.