Durante 2024 y 2025, la conversación empresarial sobre inteligencia artificial estuvo dominada por modelos y copilots.

En 2026, esa discusión cambió. La pregunta ya no es qué modelo rinde más o qué asistente escribe mejor. Ahora el foco está en cómo desplegar agentes de IA en las empresas sin generar nuevos riesgos operativos, regulatorios y reputacionales.

La adopción sigue avanzando, pero la escala real empieza a depender menos de la potencia del modelo y más de la capacidad de auditar y limitar la autonomía. Ahora el diferencial competitivo pasa por controlarla.

Índice de temas

El negocio empuja: de asistentes a automatización real

La presión de negocio existe y es fuerte. Los agentes de IA tienen la capacidad de

- Ejecutar tareas

- Coordinar procesos

- Consultar sistemas

- Operar sobre APIs

- Tomar decisiones

Desde Innovación Digital 360 les traemos una tabla con los principales datos clave sobre el uso de agentes de IA:

| Fuente | Dato clave | Qué muestra |

|---|---|---|

| Deloitte | +50% | Creció el acceso de empleados a herramientas de IA aprobadas por la empresa en un año |

| Deloitte | 85% | Las compañías esperan personalizar agentes para necesidades específicas del negocio |

| KPMG | Casi 4x | El despliegue de agentes casi se cuadruplicó en 2025 |

| Capgemini | US$ 450.000 millones | Valor potencial proyectado hacia 2028 en los mercados relevados |

Para los directorios, el atractivo es evidente. Los agentes pueden acelerar las operaciones, reducir la fricción entre áreas, automatizar los flujos de trabajo y aumentar la productividad en funciones críticas. Ahora se trata de intervenir en procesos que tienen un impacto directo en la eficiencia y la experiencia del cliente.

Pero cuanto más valor generan, mayor también es su superficie de riesgo. Porque un agente que realmente produce valor es, justamente, uno que puede hacer cosas:

- Acceder a datos

- Ejecutar acciones

- Consultar herramientas externas

- Disparar procesos internos

El riesgo cambia de escala cuando la IA puede actuar sola

Ahí aparece el verdadero punto de inflexión de este año. Cuando un sistema autónomo puede interactuar con bases de datos, código, servicios cloud, CRMs, ERPs o aplicaciones de terceros, el problema deja de ser cómo adoptar IA y pasa a ser cómo evitar incidentes o decisiones fuera de control.

No es una preocupación marginal; el Foro Económico Mundial (WEF) señaló que el 87% de los encuestados identificó las vulnerabilidades vinculadas con la IA como el riesgo cibernético de más rápido crecimiento durante 2025.

El nuevo miedo corporativo: autonomía sin límites

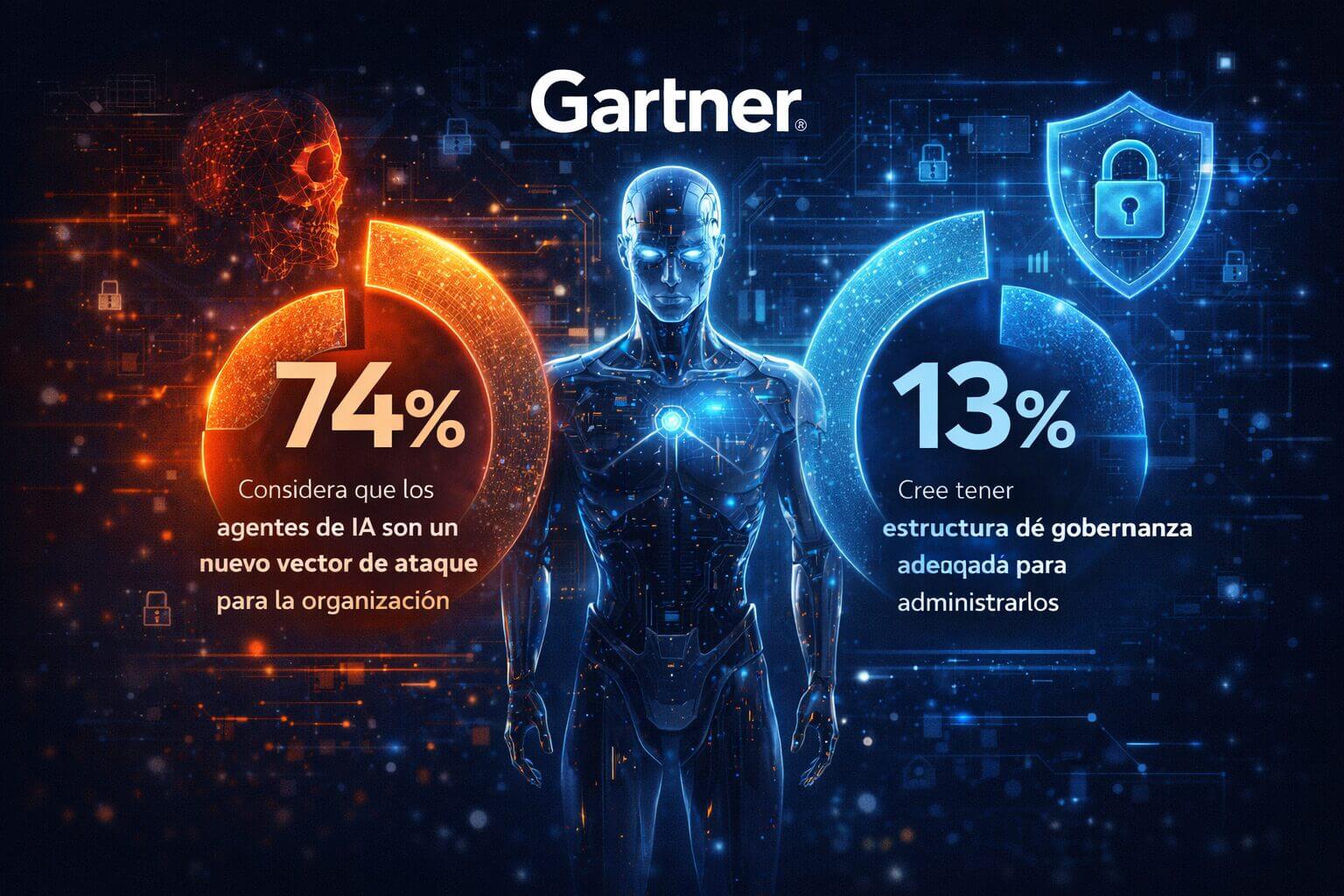

Ese temor ya no pertenece solo al área técnica. Hoy forma parte de la agenda del CEO, del CIO, del CISO y del directorio. Gartner encontró que el 74% de los líderes de aplicaciones considera que los agentes de IA representan un nuevo vector de ataque para la organización, mientras que solo el 13% cree tener la estructura de gobernanza adecuada para administrarlos.

El riesgo no es solo un error de respuesta o una alucinación del modelo. El riesgo es que el agente, con permisos válidos, haga algo que no debería hacer, como por ejemplo:

- Exponer información sensible

- Ejecutar una acción incorrecta

- Modificar un activo crítico

- Escalar un error a velocidad de máquina

En ese contexto, la autonomía sin restricciones deja de ser una virtud. De hecho, empieza a ser una amenaza.

El problema no es el modelo, sino el entorno operativo

Por eso el debate cambió de eje. La pregunta central es bajo qué condiciones se le permite operar. Como consecuencia de esta situación, la seguridad pasa a ser un requisito de diseño.

Eso implica asumir que el riesgo vive en todo el entorno operativo que lo rodea:

- Credenciales

- Permisos

- Conectores

- Herramientas

- Memoria

- Acceso a datos

- Capacidad de ejecutar acciones reales

Nace una nueva capa de infraestructura empresarial

La respuesta del mercado empieza a tomar forma en una nueva capa de infraestructura para IA autónoma. Una capa compuesta por:

- Políticas

- Permisos

- Trazabilidad

- Monitoreo

- Compliance

En términos prácticos, el desafío es construir las condiciones para que funcionen dentro de límites verificables.

Esa necesidad quedó formalizada en febrero de 2026, cuando NIST lanzó su AI Agent Standards Initiative para impulsar una adopción segura e interoperable de agentes autónomos.

Encapsular antes de escalar

El primer principio es claro: ningún agente debería operar libremente en producción sin estar encapsulado. Eso significa definir en qué entorno corre, qué herramientas puede usar, qué datos puede consultar, qué acciones puede ejecutar y bajo qué reglas debe detenerse o solicitar intervención humana.

La autonomía empresarial viable no es total. Es una autonomía acotada, gradual y gobernada.

Permisos mínimos, identidad y control de acceso

Otro cambio importante es la lógica de permisos. Al igual que en la ciberseguridad, los agentes necesitan operar bajo el principio de acceso mínimo. No deberían recibir credenciales amplias ni acceso irrestricto a sistemas sensibles. Cada agente debe contar con una identidad definida, permisos delimitados y controles de autorización acordes con su función.

No es casualidad que OWASP haya publicado en diciembre de 2025 su Top 10 de riesgos para aplicaciones agentic, que incluye el abuso de identidad, el uso indebido de herramientas y conductas autónomas fuera de control.

En la práctica, eso convierte la identidad de los agentes en una nueva frontera de seguridad corporativa.

Observabilidad, trazabilidad y auditoría continua

La otra gran exigencia es la trazabilidad. Las empresas necesitan saber qué hizo el agente, por qué lo hizo, qué datos utilizó, qué herramientas invocó y qué resultado produjo. Sin esa evidencia, no hay forma de auditar incidentes ni generar confianza en áreas críticas del negocio.

Por eso, la observabilidad pasa a ser tan importante como la inteligencia del sistema. Un agente que no deja rastros útiles es un riesgo difícil de justificar ante auditoría.

La seguridad deja de ser freno y pasa a ser habilitador

Durante años, muchas compañías vieron la seguridad como una barrera para innovar más rápido. Con la IA autónoma, esa lógica empieza a invertirse. Sin seguridad, directamente no hay escala posible.

Una prueba de concepto puede convivir con controles parciales. Pero un agente que opera en procesos de negocio reales necesita otra clase de arquitectura. Necesita:

- Políticas

- Logging

- Entornos segmentados

- Validaciones

- Aprobaciones

- Límites de ejecución

- Mecanismos de rollback o revocación

Eso también cambia el tipo de inversión. El presupuesto ya no se limita a modelos ni a licencias. Empieza a desplazarse hacia la infraestructura de control, monitoreo y resiliencia.

PwC detectó:

| Indicador | Valor | Lectura ejecutiva |

|---|---|---|

| Organizaciones que aumentarán presupuesto de ciberseguridad | 78% | La seguridad pasa al centro de la inversión |

| Empresas que ven a la IA como principal prioridad de inversión en seguridad | 36% | La IA ya redefine la agenda presupuestaria |

| Organizaciones que priorizan seguridad vinculada con IA agentic | 35% | Empieza a consolidarse una capa específica de control para agentes |

El impacto regulatorio acelera la urgencia

A la presión de negocio y al riesgo operativo se suma otro vector: la regulación. En 2026, la exigencia gana peso en múltiples jurisdicciones. Eso obliga a las compañías a pensar los agentes como una nueva responsabilidad corporativa.

Autonomía sí, pero con evidencia

La empresa que quiera escalar agentes no solo deberá demostrar que funcionan, sino también explicar cómo operan, bajo qué reglas y con qué controles.

La consecuencia es directa: desplegar agentes sin mecanismos de auditoría y control empieza a parecerse más a una nueva forma de deuda de riesgo.

La gran decisión de 2026

La carrera empresarial por la IA no se definirá únicamente por quien tenga el mejor modelo o el copiloto más vistoso. Se definirá por quién se construye la mejor arquitectura de control en torno a la autonomía.

Los líderes de negocio y tecnología deberían preguntarse qué tan contenible, explicable, revocable y auditable es un agente. Esa será la diferencia entre una empresa que experimente con IA y otra que la convierta en una capacidad empresarial sostenible.

La gran lección de 2026 es que la seguridad de la IA autónoma es la condición para que esa innovación llegue a producción, se escale y resista el escrutinio del negocio. En las empresas, un agente útil ya no alcanza. Tiene que ser también gobernable.